コメント翻訳プラグイン for わんコメ

- 無料版 v0.3.1Digital0 JPY

- 開発支援版 v0.3.1(サポート付き)Digital300 JPY

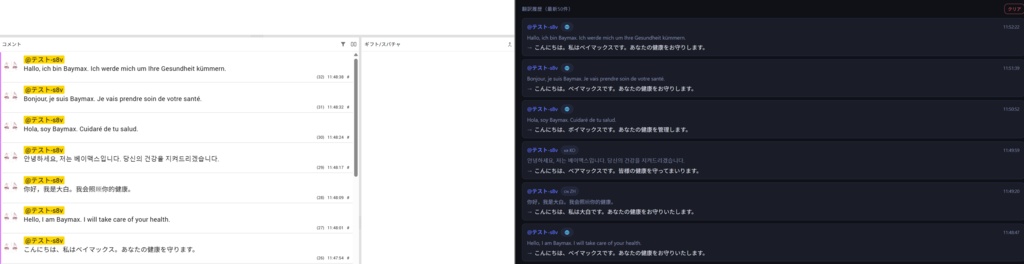

わんコメプラグインに登録して利用するツールです。 本ツールは、「わんコメ」の利用を前提としたツールです。 わんコメの利用方法については、公式サイトをご確認ください。 https://onecomme.com わんコメで受信した外国語コメントをリアルタイムで日本語に翻訳し、専用タブに表示するプラグインです。 わんコメ本体のコメント表示はそのままに、翻訳結果だけを別タブに映し出すことができます。 デモ画像は qwen3.5:9b(v0.3.0)での動作例です。

■ こんな方におすすめ

・海外リスナーのコメントを把握したい配信者の方 ・英語・中国語・韓国語など多言語コメントが届く方 ・コメントの内容を逐一確認する余裕がない方 ・APIキー不要でオフライン翻訳したい方(Ollama使用時)

■ 無料版 / サポート付き版の違い

●無料版 ・全機能を使用可能 ・本商品ページまたはGitHubからダウンロード ・サポートなし ●サポート付き版 ・全機能を使用可能(無料版と同一) ・導入・初期設定に関する質問をDMでお受けします ※対応範囲:導入・初期設定に関する質問のみ ※対応期間:購入後30日以内 ※Ollamaの動作環境構築(GPU設定・ドライバ等)は対応範囲外です。 ・機能追加・バグ修正のリクエストはGitHubのIssueまたはDMにてお願いします ※機能差はありません。継続開発への支援としてお気持ちをいただける方向けです。 ※githubでは常に最新版がDLできます。 ※購入前に無料版での動作確認を推奨します。

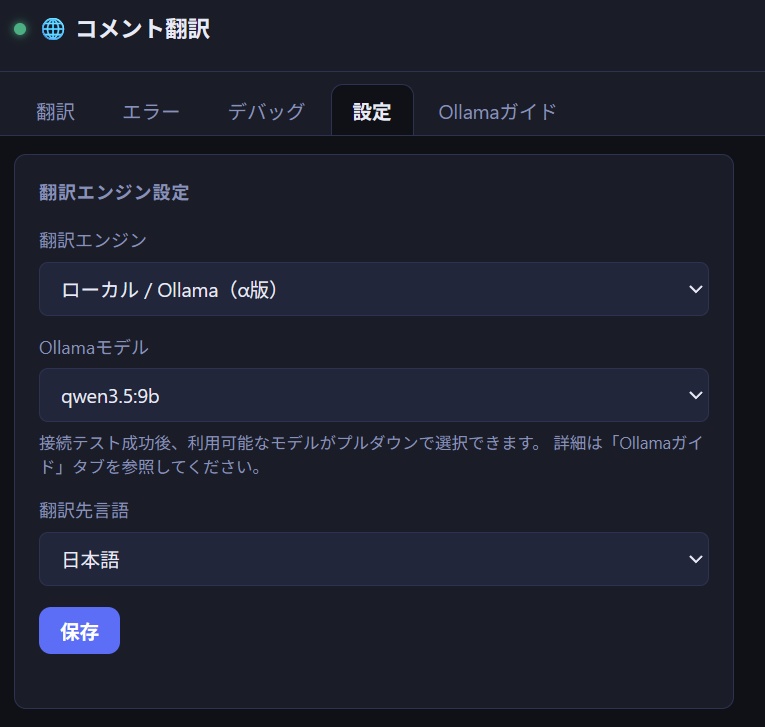

■ 翻訳エンジン

●DeepL DeepL APIキー(無料)を設定するだけで利用できます。翻訳精度が高く、導入が簡単です。 ・月50万文字まで無料 ・Free / Pro キーを自動判定 ●ローカル / Ollama OllamaをインストールしたPC上でAIモデルをローカル実行します。APIキー・インターネット接続が不要です。 ・NVIDIA GPU推奨(VRAM 6GB以上) ・対応モデル例:qwen3.5:9b / translategemma:4b など

■ 主な機能

・日本語コメントを自動スキップ(翻訳不要なコメントは処理しない) ・翻訳履歴を最新50件表示 ・エラー内容を原因・対処法つきで表示 ・デバッグログ表示 ・翻訳結果の重複排除キャッシュ

■ 動作環境

・わんコメ v5.2 以上 ・DeepLを使う場合:インターネット接続 + DeepLアカウント(無料) ・Ollamaを使う場合:NVIDIA GPU推奨(VRAM 6GB以上)、インターネット接続不要

■ 導入方法

1.本ページからzipをダウンロードします 2.ZIPを展開し、わんコメのプラグインフォルダに配置します 3.わんコメのプラグインウィンドウで再読み込み → 有効化 4.プラグインUIから翻訳エンジンとAPIキーを設定して完了です プラグインUIへのアクセス方法: ・わんコメのプラグイン管理パネルからURLボタンをクリック ・または http://localhost:11180/plugins/com.qua121.comment-translator/index.html をブラウザで開く

■ トラブルシュート

●翻訳が表示されない DeepLのAPIキーが正しく設定されているか確認してください。エラータブにエラー内容と対処法が表示されます。 ●Ollamaが接続できない Ollamaが起動しているか確認してください(ollama serve)。プラグインUIのOllamaガイドタブに手順を記載しています。 ●UIが開かない わんコメが起動しているか、URLに誤りがないかを確認してください(ポート 11180 を使用)。

■ 注意事項

・『わんコメ本体』が別途必要です(https://onecomme.com) ・本プラグインは個人開発の非公式プラグインです ・DeepL使用時、コメントテキストがDeepL社のサーバーに送信されます (Free APIはDeepLのサービス改善に使用される場合があります) ・わんコメ本体の仕様変更により、将来的に動作しなくなる可能性があります ・わんコメ無料版をご利用の配信者の方は、概要欄等に下記クレジットの記載をお願いします (わんコメ利用規約に基づく要件です) 配信者のためのコメントアプリ「わんコメ」https://onecomme.com

■ 禁止事項

・二次配布・自作発言 ・本プラグインの改変版の販売

■ 免責事項

本プラグインを導入・使用した時点で、以下の事項に同意したものとみなします。 + 各種利用規約への準拠 + 本プラグインはわんコメのプラグイン機能を通じて動作します。使用にあたっては以下の利用規約に各自で準拠してください。開発者はこれらの規約との適合性を保証しません。 ・わんコメ利用規約(https://onecomme.com に準拠) ・各配信プラットフォームの利用規約(YouTube、Twitch、ニコニコ生放送 等) ・上記規約への違反が生じた場合、その責任はユーザーに帰属します + 動作確認について + 本プラグインの動作確認は YouTube 配信環境にて行っています。Twitch・ニコニコ生放送・その他プラットフォームでの動作は保証しません。 + 翻訳エンジンの使用に関する責任 + ● DeepL を使用する場合 ・コメントのテキストが DeepL 社のサーバーに送信されます ・DeepL Free API では、送信されたテキストがサービス改善に利用される場合があります ・DeepL の利用規約(https://www.deepl.com/terms)への準拠はユーザーの責任です ● Ollama(ローカルLLM)を使用する場合 ・使用するモデルの選択はユーザー自身が行います ・選択したモデルのライセンスを遵守する責任はユーザーにあります ・特に商用配信(収益化配信等)においては、使用するモデルが商用利用を許可しているか必ず確認してください 参考として、主要モデルのライセンス種別を以下に示します。最新情報は各モデルの公式ページを参照してください。 Qwen3 / Qwen3.5 Apache 2.0 商用利用:可 TranslateGemma Gemma Terms of Use 商用利用:条件付き可(要確認) Gemma 3 Gemma Terms of Use 商用利用:条件付き可(要確認) Phi-4 / Phi-4-Mini MIT 商用利用:可 Llama 3.x Llama Community 商用利用:条件付き可(要確認) Aya Expanse CC-BY-NC-4.0 商用利用:不可(非商用限定) + 翻訳精度について + 本プラグインが提供する翻訳結果の正確性・完全性は保証しません。誤訳・訳抜け等により生じた不利益・損害について、開発者は一切の責任を負いません。 + 損害賠償の免責 + 本プラグインの使用・不使用・動作不良により生じたいかなる損害(直接・間接・偶発的損害を含む)についても、開発者は責任を負いません。

■ アップデート履歴

▼ v0.3.1(2026/03/22) ・Ollama を正式対応に格上げ(α版表記を削除) ・モデルライセンステーブルを更新(検証済みモデルを先頭に並べ替え) ▼ v0.3.0(2026/03/22) ・LLM制御トークンの混入を修正(<|endoftext|> 等を除去) ・Qwen3系のthinkingモード無効化(思考過程の混入を解消) ・LLM出力クリーニング強化(注釈・思考フレーズの自動除去) ・OLLAMA_EMPTY時の自動リトライを追加 ・Ollamaタイムアウト延長(通常5分・初回モデルロード1時間) ・Ollama翻訳を直列処理に変更(GPU負荷軽減) ・APIキー未設定時のUX改善 ▼ v0.2.2〜v0.2.3 ・非同期処理の安定性改善 ▼ v0.2.0〜v0.2.1 ・DeepL Free / Pro キー自動判定を実装 ・LRUキャッシュを実装 ・Ollamaモデルプルダウンを動的生成に変更 ▼ v0.1.0 ・初版公開

■ 連絡先

X: https://x.com/qua_q121 GitHub: https://github.com/qua121/onecomment_translator 不具合報告・要望は GitHub の Issues またはDMにてお願いします。 制作: qua121